极智芯 | 解读NVIDIA新一代Blackwell GPU架构 正式迈向MCM

先来看这篇内容《极智芯 | GPU架构与计算能力》里提到的 NVIDIA GPU 架构的发展趋势,

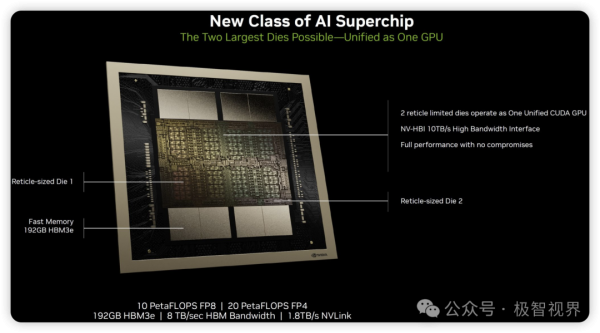

上图表中最下面紫色的 Blackwell 就是这次 NVIDIA GTC 发布的新一代的 GPU 架构,也就是 B100、B200、GB200 所搭载的 GPU 架构,包括未来的 RTX50 系列将会要搭载的 GPU 架构,也是 Hopper 架构的下一代。前面说到 Blackwell GPU 和 Hopper GPU 很不一样,Hopper 及其之前的 NVIDIA GPU 都是单 die 的,但是 Blackwell GPU 是 MCM 的,也就是两颗 B100 Chiplet 了一下。这种架构设计一旦踏足可能就会一发不可收拾,想象一下下一代的 GPU 是不是可能 4 颗 die Chiplet 一下、8 颗 die Chiplet 一下 .... 这不得玩坏了。当然,从设计单的大芯片转向设计小芯片,对于更低制程的良率提升肯定是有帮助的,这有利于切到下一代的 3nm 制程工艺。

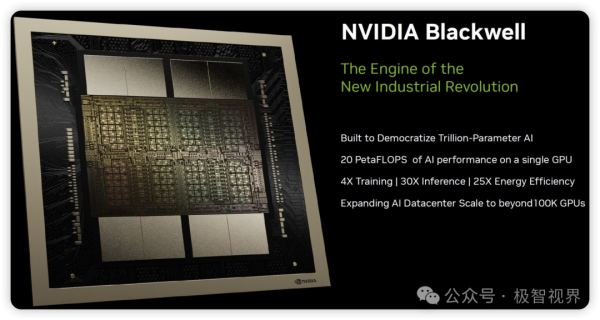

回到 Blackwell,作为新一代的 GPU 架构,自然会有很多 "领先" 的地方,下面的图就汇集了 Blackwell 架构的六大优势,下面展开。

-

世界上最强大的芯片 => Blackwell 架构集成了 2080 亿个晶体管,采用 4NP TSMC 工艺 (这里其实并没有上之前谣传的 3nm 制程工艺),两颗单个统一的 GPU 通过 chip-to-chip 10 TB/s 的方式连接成整体,因为带宽特别高,所以用户基本会无感,可以直接看成一块统一的 GPU;==> "最强大" 说的很霸道了;

-

第二代 Transformer 引擎 => 提供新的 micro-tensor 缩放支持,对于 TensorRT-LLM 和 NeMo Megatron 框架的支持更好,新支持双倍效率的 4 位低精度浮点推理;==> 你其实只要无条件的相信未来几年里新的 AI 芯片架构、新的 AI 芯片的发布都是为了更好适配、加速基于 Transformer 的大模型的训练 + 推理就行了,当然,这里的 Blackwell 也不会例外;

-

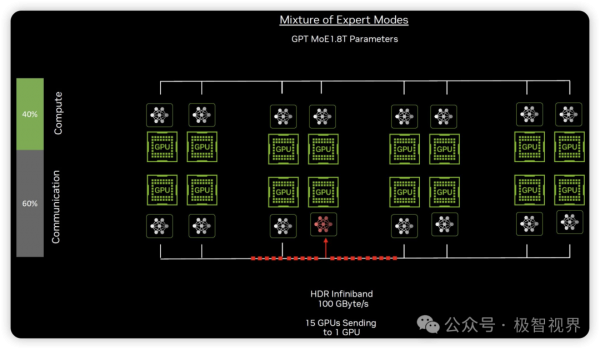

第五代 NVLink => 最新一代的 NVLink 为每个 GPU 提供了突破性的 1.8 TB/s 双向带宽,能够确保多达 576 个 GPU 之间的无缝高速互联;==> 也还是为了更好适应大模型时代,更加高的带宽无疑利好大模型的训练+推理,以及利好大算力中心的构建;

-

RAS 引擎 => 主要是上面三个,下面三个不多说了;

-

安全的 AI => 同上;

-

解压缩引擎 => 同上;

其实主要是三点,一个是本身的算力提升,第二个是低精度的推出更好适配 Transformer,第三个是互联带宽的提升。其中互联带宽的提升是特别重要的,这点是进一步拉近 GPU 冯诺依曼架构和存算一体芯片访存密集型计算效率的重要方式了,试想一下,我只要拷贝的足够快,我是不是可以像近存计算或者存算一体那样很自然的取、放数据了。下面两张图很好展示了高速互联的重要性。

与 Hopper 相比,NVIDIA Blackwell GPU 提供了 1280 亿个以上的晶体管 + 5 倍的 AI 性能 + 4 倍的显存。说到显存,Blackwell 架构 GPU 堆了 8 个 HBM3e 堆栈,通过 8192 位总线接口提供 8 TB/s 的显存带宽和高达 192 GB 的 HBM3e 显存。与 Hopper 相比,具体的性能提升如下:

-

20 PFLOPS FP8 (2.5x Hopper)

-

20 PFLOPS FP6 (2.5x Hopper)

-

40 PFLOPS FP4 (5.0x Hopper)

-

740B Parameters (6.0x Hopper)

-

34T Parameters/sec (5.0x Hopper)

-

7.2 TB/s NVLINK (4.0x Hopper)

另外还有一些重要参数汇总如下:

-

TMSC 4NP Process Node

-

Multi-Chip-Package GPU

-

1-GPU 104 Billion Transistors

-

2-GPU 208 Billion Transistors

-

160 SMs (20,480 Cores)

-

8 HBM Packages

-

192 GB HBM3e Memory

-

8 TB/s Memory Bandwidth

-

8192-bit Memory Bus Interface

-

8-Hi Stack HBM3e

-

PCIe 6.0 Support

-

700W TDP (Peak)

最后附一张 David Harold Blackwell 老爷子的图。

好了,以上分享了 解读NVIDIA新一代Blackwell GPU架构 正式迈向MCM,希望我的分享能对你的学习有一点帮助。

来源:极智视界

好文章,需要你的鼓励

高通推进数据中心CPU开发,正与头部云服务商洽谈合作

高通公司宣布正在与领先的超大规模云服务商进行深度合作谈判,开发专用于数据中心的CPU产品。CEO阿蒙表示,公司正在开发通用CPU和推理集群产品,预计2028财年开始产生收入。同时,高通面临三星在高端智能手机市场的竞争压力,三星计划在2026年推出采用2纳米工艺的新款Exynos处理器。高通Q3财报显示营收增长10%至103.5亿美元,净利润增长25%。

打破数据孤岛:哈佛大学研究团队揭示如何通过联邦学习实现隐私保护下的高效合作

这项研究由哈佛大学团队开发的创新框架,解决了多机构数据共享的核心难题。他们巧妙结合联邦学习、局部差分隐私和公平性约束,使不同机构能在保护数据隐私的同时协作开发更准确、更公平的决策模型。实验证明,该方法在多个真实数据集上既保障了隐私,又显著提升了模型公平性,为医疗、金融和政府等领域的数据协作提供了实用解决方案。

微软第四季度财报超预期 云计算和AI业务成增长引擎

微软公布2025财年第四季度业绩,营收764亿美元,同比增长18%。CEO纳德拉首次透露Azure云平台年营收超750亿美元,同比增长34%。公司计划在2025财年投入800亿美元资本支出建设AI数据中心。尽管分析师质疑AI变现能力,但投资者反应积极,推动微软股价上涨8%,市值突破4万亿美元大关。

解密“ALOHA“:Meta AI如何让机器人像人类一样灵活应对多变环境

Meta AI研究团队开发的ALOHA系统是一种低成本开源的双臂机器人远程操作平台,旨在使机器人学习更加民主化和普及化。该系统结合了价格亲民的硬件设计和先进的行为克隆学习算法,使机器人能够从人类示范中学习复杂技能。研究表明,ALOHA系统展示了强大的泛化能力,能够在新环境中应用所学技能,如打开不同类型的瓶子。系统的开源性质鼓励全球研究者参与并推动机器人学习领域的发展,尽管仍面临成本和精确力控制等挑战。